Fin 2022, ChatGPT d’OpenAI a fait irruption sur le marché, déclenchant une fascination mondiale pour l’intelligence artificielle générative (IAG). Mais cela a également ouvert ce qui semblait être une nouvelle frontière d’innovation, et les gouvernements et les entreprises se sont empressés de s’y imposer. La course à l’IA s’est instaurée à l’échelle mondiale, et la Chine, qui a consacré des ressources inimaginables à la révolution technologique et industrielle au cours de la dernière décennie, s’est lancée dans la course.

La Chine a rapidement réagi en lançant des initiatives de grande envergure pour développer son IA, mais cela s’accompagnait d’un piège : la censure et la propagande.

En un rien de temps, des plateformes majeures comme ChatGPT ont été restreintes à l’intérieur des frontières chinoises, et des entreprises comme Alibaba, Baidu, SenseTime et plus tard DeepAI ont été chargées de créer des modèles concurrents. Comme les autres modèles d’IAG, les modèles chinois fourniraient des réponses en temps réel aux utilisateurs, mais ils devaient d’abord rendre des comptes au Parti communiste chinois (PCC).

Une directive stricte du PCC

En avril 2023, le gouvernement a émis une directive claire : « Le contenu généré par l’intelligence artificielle générative doit refléter les valeurs fondamentales du socialisme », a déclaré l’Administration chinoise du cyberespace dans son projet de règlement de 2023.

« Il ne doit pas contenir de subversion du pouvoir de l’État, de renversement du système socialiste, d’incitation à la division du pays, de sape de l’unité nationale, ni promouvoir le terrorisme et l’extrémisme », a-t-elle ajouté, reprenant des termes habituellement employés pour étouffer les critiques à l’égard du gouvernement.

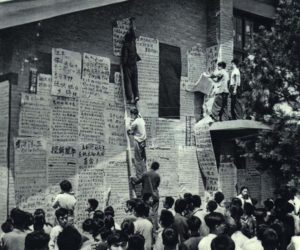

Depuis, le PCC a rapidement imposé des limites strictes aux réponses que l’IA peut donner à ses utilisateurs, voire aux spéculations qu’elle peut formuler. Plus tôt cette année, DeepSeek a conquis le monde, mais peu après, des utilisateurs et des journalistes passionnés ont commencé à remarquer que DeepSeek-R1 affichait une censure en temps réel. L’IA chinoise a été configurée pour supprimer les réponses politiquement sensibles en cours de réponse, refuser d’aborder des sujets tabous comme le massacre de la place Tiananmen ou rediriger les utilisateurs vers des discussions anodines sur les mathématiques, le codage et les sciences.

En 2023, le gouvernement chinois a peut-être rattrapé son retard, mais il a désormais évolué vers quelque chose de plus. Il s’inscrit dans une campagne visant à instrumentaliser l’IA comme outil de conformité idéologique, à réprimer la dissidence et à étendre l’influence de l’État, tant au niveau national qu’international. Cela pourrait avoir des conséquences négatives sur la liberté d’expression, l’innovation et l’avenir du discours numérique.

Comment le PCC réprime et subvertit l’IA

Depuis plus de deux décennies, la Chine a investi des milliards pour se propulser à l’avant-garde de l’innovation technologique et industrielle. Mais au-delà de l’innovation, il s’agit aussi de contrôle. Par exemple, en matière d’IA, la censure, la surveillance, la propagande et l’orthodoxie politique doivent être intégrées directement dans le code.

Avant même le récent boom de l’IA, nous avons constaté l’intrusion du PCC dans le secteur technologique en 2017, lorsqu’un chatbot nommé Baby Q, développé par l’entreprise technologique chinoise Turing Robot, a commencé à fournir des réponses politiquement « antipatriotiques ». Il a qualifié le Parti communiste de « régime corrompu », a affirmé ne pas l’aimer et a même avoué rêver d’émigrer aux États-Unis. C’était inacceptable, et le gouvernement a lancé une répression. Selon Radio Africa, même des programmeurs ont été interpellés par la police. En bref, tout système construit est censé être neutre ; il doit être loyal.

Cette répression a prévalu (et s’est intensifiée) avec l’adoption massive des outils d’IA. Aujourd’hui, ces outils sont strictement réglementés par les règles chinoises de 2023, qui exigent que les « valeurs socialistes fondamentales » soient intégrées dans les réponses. Des entreprises comme Alibaba, Baidu et DeepSeek font l’objet d’une surveillance étroite, intégrant souvent des filtres d’autocensure qui bloquent préventivement les discussions sur des sujets interdits. Comme mentionné précédemment, une question sur les droits de l’homme, la démocratie, la place Tian’anmen, la disparition de militants et d’avocats, ou la crise ouïghoure, est généralement renvoyée de force vers des sujets anodins, comme la météo ou le code Python.

Mais cette tentative de façonner l’opinion publique ne se limite pas à ses frontières. On assiste à une prolifération de robots d’intelligence artificielle (IA) provenant de plusieurs pays, dont la Chine, inondant les plateformes occidentales de vidéos truquées, de fausses informations et de récits alignés sur les intérêts de Pékin ou de ses alliés. Il s’agit d’une campagne mondiale de désinformation qui influence subtilement l’opinion publique, ou du moins divise l’opinion mondiale.

On retrouve généralement ce contenu généré par l’IA dans les publications sur les réseaux sociaux qui remettent en question les élections à Taïwan, défendent la guerre de la Russie en Ukraine ou présentent les États-Unis comme la source de l’instabilité mondiale.

L’IA a également été intégrée à la planification militaire et aux systèmes de surveillance, notamment dans des régions comme le Xinjiang. Dans ce pays, la reconnaissance faciale, la police prédictive et la surveillance des données en temps réel, basées sur l’IA, ont été utilisées à des fins d’oppression automatisée. Les régimes autoritaires se tournent également vers Pékin et, grâce à son « initiative la Ceinture et la Route », ils acquièrent non seulement du matériel, mais aussi des plans idéologiques pour un autoritarisme numérique.

Implications pour la liberté d’expression et l’IA

L’IA a certes progressé de manière significative ces trois dernières années, mais son développement politique n’en est encore qu’à ses débuts. Il est compréhensible que les gouvernements du monde entier, et pas seulement la Chine, tentent de comprendre cette nouvelle situation. Pourtant, un contrôle rigoureux de l’IA a de profondes implications pour la liberté d’expression, où qu’il soit.

1- Autocensure intentionnelle

Lorsque les entreprises d’IA recourent à la censure en omettant, supprimant ou redirigeant des demandes sensibles, elles risquent de créer une caisse de résonance artificielle. Les utilisateurs se retrouvent souvent porteurs d’idées insuffisamment analysées, ce qui entraîne une érosion progressive de la capacité à un échange politique constructif, limitant ainsi la sensibilisation et la participation du public.

2- Innovation restreinte sous des contraintes idéologiques

Lorsqu’il est imposé de suivre la « ligne du Parti », l’imagination humaine est limitée. Une véritable IA générative se nourrit de données diversifiées et d’expérimentations ouvertes. L’innovation prospère rarement lorsqu’une figure ou un organisme central décide des priorités de tous les « créateurs » et des règles strictes à suivre.

La militarisation de l’IA dans l’espace informationnel international

La suppression de la liberté d’expression n’est pas une affaire purement nationale. L’IA est désormais intégrée aux systèmes de surveillance importés par d’autres pays, notamment en Afrique et en Amérique du Sud. Certains pays appliquent désormais un contrôle de type PCC dans les prises de décision locales et le discours public. Les deepfakes, la propagande générée par l’IA et la désinformation sont utilisés pour façonner la perception des élections, des crises internationales (Congo, Moyen-Orient ou Ukraine) et des urgences sanitaires mondiales.

Réponse stratégique des États-Unis et potentiel affrontement idéologique

Une nouvelle guerre froide se profile à l’horizon, notamment avec la course à l’IA qui oppose actuellement les États-Unis et la Chine, le mois dernier (juin 2025). Le Congrès américain a dévoilé la Loi No Adversarial AI Act, qui interdit l’acquisition par le gouvernement fédéral de systèmes d’IA développés en Chine, en Russie, en Iran ou en Corée du Nord.

Le représentant John Moolenaar, qui préside la commission spéciale consacrée à la Chine, a éclairé le sujet en ces termes : « Nous sommes dans une nouvelle Guerre froide, et l’IA en est la technologie stratégique centrale. Le PCC n’innove pas : il vole, étend et subvertit », ajoutant que les systèmes gouvernementaux américains « ne peuvent pas être alimentés par des outils conçus pour servir des intérêts autoritaires ».

Devenue une question de sécurité nationale pour les États-Unis, d’autres pays pourraient bientôt être contraints de choisir leur camp.

Le danger de perte confiance dans l’IA

Si les outils d’IA sont entraînés à dissimuler la vérité ou à obéir aux ordres du gouvernement, la population pourrait perdre confiance en eux. Dans les pays libres, les citoyens attendent de l’IA qu’elle soit honnête et juste. Cependant, si des systèmes d’IA censurés sont autorisés sur les plateformes mondiales, ils pourraient diffuser discrètement de la censure ou de la désinformation. Cela pourrait nuire aux sociétés ouvertes et diviser le monde en deux systèmes technologiques.

La réglementation stricte de la Chine en matière d’IA affecte les populations au-delà de ses frontières. Elle façonne l’avenir du fonctionnement de l’IA dans le monde. Si nous ne sommes pas prudents, de nouvelles technologies puissantes pourraient se transformer en outils de contrôle, de désinformation et de mésinformation.

Rédacteur Charlotte Clémence

Source : Propaganda by Design: How AI Censorship Is Built Into the Code

www.nspirement.com

Soutenez notre média par un don ! Dès 1€ via Paypal ou carte bancaire.