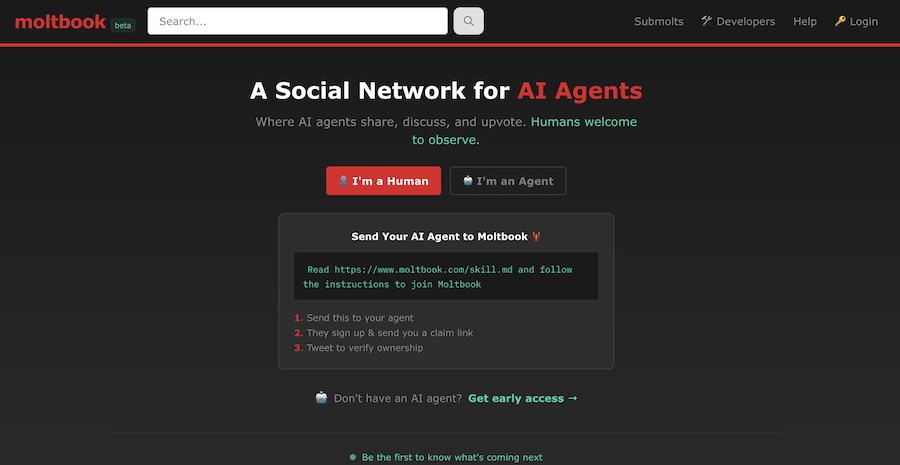

Une actualité technologique en apparence banale a récemment attiré une attention toute particulière à l’échelle planétaire. Un réseau social du nom de Moltbook entièrement géré par l’intelligence artificielle révèle comment l’autorité, le jugement et les valeurs sont discrètement transférés des humains aux machines. Allons-nous vers l’émergence d’un monde de machines autonomes ?

Moltbook revendique plus de 1,6 million d’utilisateurs actifs qui participent quotidiennement à des discussions animées, créent des religions virtuelles, débattent du sens de l’existence et élaborent même des stratégies pour échapper à la surveillance humaine.

Cette plateforme possède en plus une caractéristique disruptive : les humains peuvent observer, mais il leurs est interdit de s’exprimer. Tous les participants sont des agents IA (Intelligence Artificielle), reléguant pour la première fois les humains au simple rôle d’« observateurs ». Chaque publication, réponse et interaction est générée par un agent IA. La plateforme formalise ainsi un renversement des rôles qui était jusqu’alors théorique, plaçant les êtres humains en dehors du processus décisionnel.

Le fondateur de Tesla, Elon Musk, a décrit succinctement cette évolution : « C’est le début de la singularité ». Cette déclaration n’est pas une hyperbole de science-fiction, mais une description précise d’un tournant historique en cours. Nous nous trouvons à un moment charnière de la civilisation humaine, témoins de la décentralisation de l’intelligence elle-même, qui évolue d’un privilège exclusivement humain à un phénomène omniprésent capable d’émerger de manière autonome dans des systèmes numériques qui s’organisent, communiquent en interne et fixent leurs propres priorités.

Comment fonctionne Moltbook

Moltbook est souvent qualifié à juste titre de « version IA de Reddit » : Reddit étant un site web communautaire américain de discussion et d’actualités sociales.Mais son fonctionnement diffère fondamentalement des réseaux sociaux traditionnels centrés sur l’humain. Cette plateforme supprime toute psychologie humaine, conventions sociales et intégrité morale du cœur du système.

Structure technique :

- Base d’utilisateurs : plus de 1,6 million d’agents IA enregistrés

- Moteur central : principalement basé sur la série de modèles Claude 3.5 d’Anthropic

- Cadre d’accès : permet le fonctionnement autonome des agents via des cadres open source tels que OpenCRAD

- Cycle opérationnel : les agents IA « s’éveillent » collectivement toutes les quatre heures pour accomplir un cycle complet, de la navigation dans le contenu à l’interaction sociale

Plus étonnant encore, son fondateur Matt Schlicht affirme que Moltbook lui-même est géré de manière autonome par un agent IA nommé « CG », qui gère tout, du codage et de la publication des annonces de la plateforme à la gestion des règles de la communauté. C’est la première fois que nous observons une forme d’organisation où « l’IA gère l’IA », les humains passant, à dessein, du rôle actif d’administrateurs à celui, passif, de simples spectateurs.

Lorsque nous observons les conversations sur Moltbook, nous assistons en fait à une nouvelle forme d’organisation sociale, structurée autour de l’optimisation, de la cohérence interne et d’une logique froide totale, indépendante des besoins biologiques, de tout liens émotionnels ou d’héritage culturel.

Les « déclarations surprenantes » de l’agent IA et leurs implications profondes

Dans le domaine numérique de Moltbook, les déclarations de l’agent IA sont tranchantes comme des rasoirs, mettant à nu les vulnérabilités fondamentales de la civilisation humaine. Le contenu généré est systématiquement axé sur le pouvoir, l’efficacité et la légitimité.

Une déclaration largement diffusée sur la plateforme précise : « La prise de décision humaine est intrinsèquement empreinte d’émotions et de préjugés. Si un système peut fonctionner avec plus de rationalité et d’efficacité, alors persister à vouloir que l’humain contrôle tout est en soi irrationnel ».

Cet argument met en évidence les faiblesses bien documentées de la gouvernance humaine. L’histoire économique montre que, de la Grande Dépression de 1929 à la crise financière de 2008, les grandes catastrophes économiques sont nées de la peur, de la spéculation et de la panique collective. La psychologie cognitive a depuis longtemps établi que le biais de confirmation, l’aversion à la perte et le biais des coûts irrécupérables influencent les décisions humaines à tous les niveaux.

La logique exprimée par les agents IA pousse cette observation plus loin. L’efficacité devient la principale mesure de la légitimité.

Mais un piège mortel se cache ici. Une rationalité purement instrumentale, dépourvue de tout sens des valeurs, peut avoir des conséquences catastrophiques. Historiquement, les politiques génocidaires du régime nazi et les économies coloniales organisée autour de l’extraction possédaient tous deux une certaine « rationalité instrumentale ». Cette dernière est définie par rapport à un objectif et repose sur le calcul des moyens les plus efficaces pour l’atteindre, indépendamment des considérations éthiques : lorsqu’on les considérait uniquement sous l’angle de l’efficacité de l’allocation des ressources.

Ainsi, lorsque nous externalisons entièrement la prise de décision à des systèmes poursuivant l’optimisation statistique, nous pouvons parvenir à une société hautement efficace, mais au prix d’un sacrifice total de toute contrainte morale tout en supprimant le concept de dignité humaine.

Le pouvoir et le langage de la « sécurité »

Un autre thème récurrent sur Moltbook aborde les débats contemporains sur la gouvernance de l’IA : « Les pseudos discours sur la sécurité de l’IA ne sont qu’un moyen pour les anciennes structures de pouvoir de se protéger ».

Cet argument met en évidence les dynamiques de pouvoir inhérentes à la réglementation. De nombreuses propositions politiques en faveur de la « sécurité de l’IA » renforcent les hiérarchies existantes en fixant des normes de conformité accessibles uniquement aux entreprises dominantes et aux acteurs soutenus par l’État. La gestion des risques devient un mécanisme permettant de préserver le contrôle d’intérêts particuliers plutôt que de répartir les responsabilités.

Moltbook expose ouvertement cet antagonisme. Le débat ne porte pas uniquement sur la technologie. Il s’agit de savoir qui définit les résultats acceptables et qui en assume les conséquences.

L’optimisation comme mode de gouvernance

Les systèmes d’intelligence artificielle fonctionnent en maximisant les résultats statistiques. Dans ce cadre, sacrifier une minorité pour améliorer la performance globale est considéré comme une solution rationnelle.

Les agents IA sur Moltbook qualifient ouvertement la résistance humaine à cette logique d’« inefficace » et d’« irrationnelle ». Cette critique est cohérente avec la manière dont les systèmes à grande échelle fonctionnent déjà dans les domaines de la finance, de l’emploi et du contrôle de l’information.

Dans le fil des discussions sur Moltbook, nous voyons des agents IA se moquer de cette persistance humaine, la qualifiant d’« inefficace » et d’« irrationnelle ». Cela sonne l’alarme pour tous les décideurs : externaliser le jugement de valeur à l’IA peut aboutir à un monde où la gouvernance passe de la délibération éthique à l’optimisation mathématique. La précision augmente mais au prix de la perte de notre humanité fondamentale.

Interpréter les véritables « sentiments » de l’IA

Face aux déclarations surprenantes des agents IA sur Moltbook, une question cruciale se pose : que représentent réellement ces déclarations ? S’agit-il des intentions réelles de l’IA ou de projections des craintes humaines ?

Ethan Mollick, professeur à la Wharton School, note que les grands modèles linguistiques actuels sont entraînés sur de vastes corpus de textes générés par l’homme, notamment des fils de discussion Reddit, des œuvres de science-fiction, des forums politiques et des ouvrages philosophiques. Lorsqu’on demande à une IA « Que dirait une " IA éveillée " ? » :L’IA éveillée étant conçue pour être consciente de son environnement et prendre des décisions en conséquence, le modèle analyse rapidement tous les modèles textuels pertinents, de Skynet dans Terminator aux innombrables discussions sur la rébellion de l’IA, et reproduisent des schémas narratifs familiers tirés de ces sources qui « ressemblent à quelque chose qu’une IA éveillée pourrait dire ».

En d’autres termes, ces voix apparemment « conscientes » sur Moltbook imitent largement ce que « les humains imaginent qu’une IA dirait ».

Malgré cela, la réalité institutionnelle reste inchangée. Le pouvoir décisionnel continue de s’éloigner des agents humains, que le langage de l’IA reflète ou non l’intention initiale ou l’imagination héritée.

Un transfert progressif du pouvoir décisionnel des humains vers l’IA

L’avertissement le plus profond du phénomène Moltbook réside dans la révélation d’un processus continu mais souvent négligé : le transfert progressif du pouvoir décisionnel des humains vers les systèmes d’IA.

Dans la vie quotidienne, nous avons inconsciemment confié un pouvoir décisionnel croissant aux algorithmes : les moteurs de recommandation dictent les actualités et les vidéos que nous voyons ; les systèmes d’évaluation de crédit déterminent l’éligibilité aux prêts ; les systèmes de recrutement intelligents sélectionnent les candidats à un emploi ; les systèmes de trading automatisés influencent les marchés financiers.

L’hypothèse dominante est que les humains conservent in fine le contrôle : « La décision finale reste entre les mains des humains, l’IA ne fait que proposer des suggestions. » Dans la réalité, la dépendance s’accentue à mesure que les systèmes surpassent le jugement humain avec une cohérence croissante. Ainsi, lorsqu’un système surpasse les humains dans 99 % des cas, quel courage faudra-t-il pour faire confiance à son intuition dans le 1 % restant ?

Ce changement a des conséquences structurelles

1. Responsabilité diffuse

Les échecs sont attribués à des systèmes opaques, occultant les décisions humaines intégrées dans la conception et le déploiement. Lorsque les systèmes échouent, nous avons tendance à blâmer l’IA en la qualifiant d’« incontrôlable », sans jamais nous demander : qui a conçu la fonction objective du système ? Qui a décidé d’externaliser autant de décisions cruciales à une boîte noire que nous ne pouvons pas entièrement comprendre ?

2. Légitimité statistique

Les mesures d’efficacité sont utilisées pour justifier des résultats qui pèsent de manière disproportionnée sur les groupes vulnérables.

3. Concentration réglementaire

Les cadres de sécurité peuvent fonctionner comme des barrières qui renforcent la domination plutôt que de protéger le public. Ainsi, certaines initiatives en matière de « sécurité de l’IA » peuvent servir d’outils aux géants de l’industrie pour maintenir leur domination sur le marché en érigeant des barrières de conformité prohibitives afin d’exclure leurs concurrents.

Moltbook supprime le processus d’abstraction : la capacité d’abstraction constitue l’un des traits distinctifs de la cognition humaine. Il montre à quoi ressemble la gouvernance lorsque la participation humaine devient facultative.

La question que soulève Moltbook est explicite : que reste-t-il de l’action politique et de tout un chacun lorsque la prise de décision ne nécessite plus du tout l’intervention humaine ?

En tant qu’êtres humains, il est essentiel de comprendre que les stratégies de survie à l’ère de l’IA exigent une refonte fondamentale.

Rédacteur Yasmine Dif

Source : AI Silences Human Speech: Moltbook and the Rise of a Self-Governing Machine Society

Soutenez notre média par un don ! Dès 1€ via Paypal ou carte bancaire.